KI und Energiesouveränität

KI-Rechenleistung unter Energiebegrenzung

Systemnavigation

Dieser Artikel sollte als die Rechenleistungs-Energie-Übertragungsschicht zwischen Halbleitersouveränität, Hyperscale-Infrastruktur, verteilter Intelligenz, industriellen KI-Systemen, Energiearchitekturen und europäischer strategischer Autonomie gelesen werden.

Er verbindet Halbleitersysteme mit der umfassenderen physischen Architektur künstlicher Intelligenz unter Bedingungen eines energiegebundenen Systems.

Er sollte zusammen gelesen werden mit:

Kernaussage

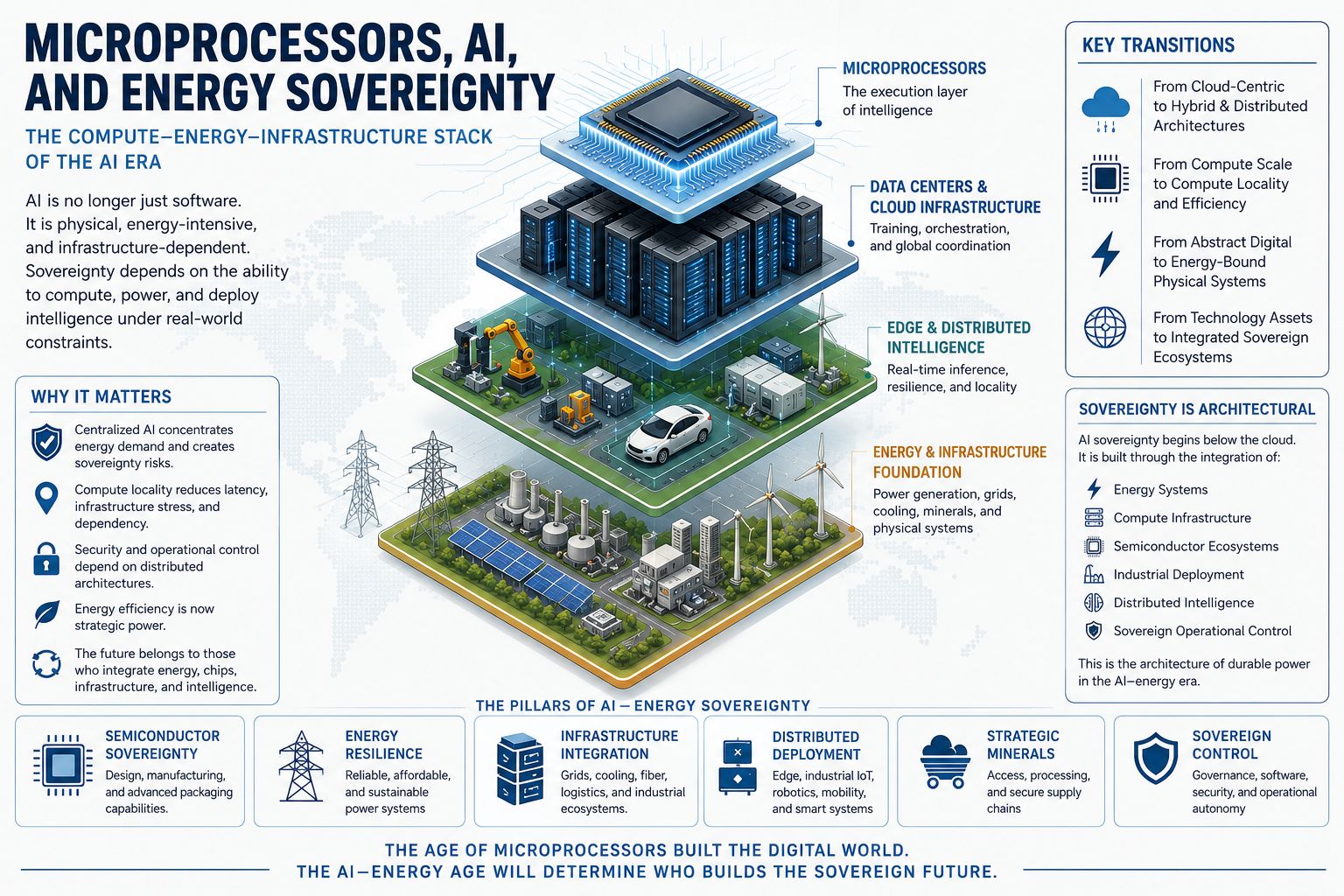

Das Zeitalter der Halbleiter entwickelt sich zunehmend zu einem Rechenleistungs-Energie-Zeitalter.

Über mehrere Jahrzehnte hinweg schien technologische Macht immer stärker von physischen Systemen entkoppelt zu sein. Software, Cloud-Plattformen, finanzielle Abstraktion, digitale Skalierbarkeit und Netzwerkeffekte erzeugten die Wahrnehmung, dass Rechenleistung unabhängig von Geografie, Infrastruktur und materiellen Begrenzungen expandieren könne.

Künstliche Intelligenz kehrt diese Annahme zunehmend um.

KI beseitigt physische Abhängigkeit nicht.

Sie intensiviert sie.

Mit der Skalierung rechnerischer Systeme hängt Intelligenz zunehmend von Stromerzeugung, Netzstabilität, Kühlsystemen, Halbleiterfertigung, mineralischen Lieferketten, Rechenzentren, Glasfaserinfrastruktur, Übertragungssystemen, industriellen Ökosystemen und regionaler Infrastrukturintegration ab.

Unter diesen Bedingungen können Mikroprozessoren nicht länger lediglich als elektronische Komponenten verstanden werden, die in Geräte eingebettet sind. Sie fungieren zunehmend als Ausführungsschichten innerhalb einer wesentlich größeren Systemarchitektur, die Energie, Infrastruktur, Rechenleistung, Logistik, industrielle Produktion und geopolitische Macht miteinander verbindet.

Der strategische Engpass beschränkt sich daher nicht länger allein auf die Halbleiterfertigung.

Die umfassendere Begrenzung betrifft zunehmend:

Energieverfügbarkeit,

Infrastrukturintegration,

Kühlungskapazität,

Platzierung von Rechenleistung,

Übertragungssysteme,

Bereitstellungsarchitektur,

und souveräne operative Kontrolle über Intelligenzsysteme.

Dieser Übergang verbindet künstliche Intelligenz erneut mit Geografie.

Er verändert zugleich die Bedeutung von Souveränität im digitalen Zeitalter.

KI-Souveränität hängt zunehmend nicht nur davon ab, wer Modelle entwickelt, sondern davon, wer Intelligenz unter Bedingungen energetischer Begrenzung physisch aufrechterhalten, verteilen, optimieren, steuern und in realen Systemen einsetzen kann.

1. Die Halbleiterfrage ist zu einer Infrastrukturfrage geworden

Die Halbleiterindustrie entstand ursprünglich innerhalb der umfassenderen industriellen Logik von Computer-Miniaturisierung, Verarbeitungsgeschwindigkeit und rechnerischer Effizienz.

Über Jahrzehnte konzentrierte sich technologischer Wettbewerb vor allem auf:

Prozessorleistung,

Transistordichte,

Fertigungspräzision,

und Produktionsmaßstab.

Diese Dimensionen bleiben strategisch wichtig.

Künstliche Intelligenz verändert jedoch die systemische Position von Halbleitern innerhalb der umfassenderen technologischen Architektur.

Mit der Ausweitung von KI auf industrielle Systeme, Logistik, Stromnetze, Verteidigungsinfrastruktur, Finanzsysteme, Gesundheitswesen, Transport, Fertigung, Robotik und öffentliche Verwaltung lautet die Frage nicht länger lediglich, ob fortgeschrittene Chips gefertigt werden können.

Die tiefere Frage lautet zunehmend, ob vollständige Intelligenzsysteme unter Bedingungen physischer Begrenzung nachhaltig betrieben werden können.

Ein Prozessor ohne Elektrizität kann nicht rechnen.

Ein Rechenzentrum ohne Kühlung kann nicht skalieren.

Ein KI-Modell ohne Infrastrukturintegration kann nicht zuverlässig funktionieren.

Eine Cloud-Architektur ohne Netzresilienz wird strategisch fragil.

Ein Halbleiter-Ökosystem ohne Energieübertragungskapazität kann großskalige Rechenleistung nicht aufrechterhalten.

Unter KI-Energie-Bedingungen wird Rechenleistung selbst infrastrukturbasiert.

Dies ist der kritische Übergang.

Die Halbleiterfrage ist daher nicht länger lediglich eine industriepolitische Frage.

Sie wird zunehmend:

zu einer Frage von Energiesystemen,

zu einer Frage infrastruktureller Koordination,

zu einer Frage territorialer Resilienz,

und letztlich zu einer Frage der Souveränität.

2. Künstliche Intelligenz ist physisch geworden

Künstliche Intelligenz wird häufig primär durch die Sprache der Software beschrieben.

Diese Einordnung wird zunehmend unzureichend.

KI ist physisch geworden, weil die Ausweitung rechnerischer Intelligenz heute enorme Mengen benötigt an:

Elektrizität,

Kühlung,

Transformatoren,

Umspannwerken,

Wassersystemen,

Halbleitern,

Seltene-Erden-Verarbeitung,

Kabelinfrastruktur,

industrieller Fertigung,

logistischer Kapazität,

und hochdichter Recheninfrastruktur.

Das umfassendere KI-System ähnelt zunehmend industrieller Infrastruktur und nicht bloß digitaler Abstraktion.

Diese Transformation ist kritisch, weil sie physische Grenzen wieder in das Zentrum technologischer Macht zurückführt.

Der moderne KI-Stack hängt heute gleichzeitig ab von:

Halbleiterfertigung,

Energiesystemen,

mineralischen Ökosystemen,

Recheninfrastruktur,

industrieller Implementierung,

und logistischer Koordination.

Mit der Beschleunigung der KI-Skalierung werden diese physischen Ebenen zunehmend voneinander abhängig.

Das Ergebnis ist, dass Intelligenz selbst zunehmend begrenzt wird durch:

Stromverfügbarkeit,

Infrastrukturdichte,

Energiepreise,

Kühlungseffizienz,

und territoriale Bereitstellungskapazität.

Genau deshalb kann KI nicht länger ausschließlich durch Software-Rahmenwerke verstanden werden.

Das Zeitalter der KI wird zunehmend zu einem Zeitalter des Wettbewerbs um Recheninfrastruktur.

3. Zentralisierte KI konzentriert Energie- und Souveränitätsrisiken

Das weltweit entstehende dominante Modell künstlicher Intelligenz ist hochgradig zentralisiert.

Großskalige Frontier-Systeme hängen zunehmend ab von:

Hyperscale-Rechenzentren,

konzentrierten Rechenleistungsclustern,

vertikal integrierten Cloud-Plattformen,

proprietären Beschleunigern,

und massivem Stromverbrauch.

Diese Architektur bietet erhebliche Vorteile für:

großskaliges Modelltraining,

Plattformintegration,

Kapitalkonzentration,

und rechnerische Skalierung.

Sie erzeugt jedoch zugleich systemische Verwundbarkeiten.

Zentralisierte KI konzentriert Stromnachfrage geografisch.

Sie verstärkt den Druck auf:

Übertragungssysteme,

Kühlinfrastruktur,

lokale Stromnetze,

Wassersysteme,

industrielle Stromallokation,

und regionale Energiemärkte.

Mit der Ausweitung des KI-Einsatzes kollidieren diese Belastungen zunehmend mit umfassenderen Elektrifizierungsanforderungen, die entstehen aus:

industrieller Dekarbonisierung,

Elektrifizierung des Verkehrs,

Heizsystemen,

Netzmodernisierung,

und Integration erneuerbarer Energien.

Unter Bedingungen eines energiegebundenen Systems entsteht dadurch ein struktureller Wettbewerb um Energieallokation.

Die Frage lautet nicht lediglich, ob theoretisch genügend Elektrizität erzeugt werden kann.

Die Frage lautet vielmehr, ob Intelligenzsysteme skalieren können, ohne die umfassendere Infrastrukturarchitektur zu destabilisieren, von der industrielle Gesellschaften abhängen.

Dies erzeugt ein Souveränitätsproblem.

Eine rein cloud-zentrierte KI-Strategie kann gleichzeitig die Abhängigkeit erhöhen von:

externen Cloud-Anbietern,

importierten Beschleunigern,

ausländischen Orchestrierungsschichten,

externen Software-Ökosystemen,

konzentrierten Infrastrukturnoten,

und zunehmend fragilen Energiearchitekturen.

Unter solchen Bedingungen schwächt sich Souveränität ab, selbst während rechnerische Fähigkeiten expandieren.

4. Rechenleistungs-Lokalität als Souveränitätsdoktrin

Rechenleistungs-Lokalität entsteht als alternative Systemlogik.

Anstatt davon auszugehen, dass Intelligenz primär innerhalb zentralisierter Hyperscale-Infrastrukturen ausgeführt werden sollte, argumentiert die Rechenleistungs-Lokalität, dass bedeutende Teile der KI-Ausführung möglichst nahe an den Orten stattfinden sollten, an denen Daten erzeugt werden und operative Entscheidungen erforderlich sind.

Dies umfasst:

industrielle Systeme,

Energienetze,

Logistiksysteme,

Häfen,

Fahrzeuge,

Gesundheitssysteme,

Fertigungsanlagen,

öffentliche Infrastruktur,

und lokale operative Umgebungen.

Innerhalb dieser Architektur wird Intelligenz zunehmend verteilt.

Die Cloud bleibt wichtig für:

Modelltraining,

Aggregation,

Koordination,

großskalige Optimierung,

und Ökosystem-Orchestrierung.

Die Cloud fungiert jedoch nicht länger als ausschließliche Ausführungsschicht.

Dieser Übergang verändert die strategische Architektur von KI grundlegend.

Verteilte Inferenz reduziert:

unnötige Datenbewegung,

Latenzexposition,

Bandbreitenabhängigkeit,

Belastung zentralisierter Infrastruktur,

und konzentrierte Energienachfrage.

Gleichzeitig erhöht sie:

territoriale Resilienz,

operative Kontinuität,

infrastrukturelle Redundanz,

lokale Autonomie,

und Energieeffizienz.

Am wichtigsten ist jedoch, dass Rechenleistungs-Lokalität Intelligenz wieder mit physischen Bereitstellungsumgebungen verbindet.

KI wird innerhalb der Infrastruktur selbst eingebettet.

Deshalb fungiert Rechenleistungs-Lokalität zunehmend nicht nur als technische Optimierungsstrategie, sondern als Souveränitätsdoktrin.

5. Mikroprozessoren werden zur Ausführungsschicht verteilter Intelligenz

Rechenleistungs-Lokalität ist nur möglich, weil sich Mikroprozessorarchitekturen weiterentwickeln.

Moderne System-on-Chip-Architekturen integrieren zunehmend:

CPUs,

GPUs,

NPUs,

Speichersysteme,

Sensorintegration,

Sicherheitsfunktionen,

und Energiemanagementfähigkeiten

innerhalb hochoptimierter lokaler Umgebungen.

Dadurch können KI-Workloads direkt auf Geräten, Maschinen, Fahrzeugen, industriellen Systemen, Robotikplattformen und lokalen Infrastrukturnoten ausgeführt werden.

Die strategische Bedeutung dieses Übergangs ist tiefgreifend.

Mikroprozessoren bestimmen zunehmend:

ob Inferenz lokal ausgeführt werden kann,

ob Infrastruktur unter eingeschränkter Konnektivität funktionsfähig bleibt,

ob industrielle Systeme Autonomie bewahren,

ob Energieintensität reduziert werden kann,

und ob Intelligenzarchitekturen unter systemischem Stress resilient bleiben.

Die wichtigste Lehre ist eher architektonisch als unternehmensbezogen.

Apples Silicon-Ökosystem, ARM-basierte Effizienzmodelle, industrielle KI-Prozessoren, Edge-Beschleuniger, eingebettete KI-Systeme, Robotikprozessoren und energieeffiziente Inferenzarchitekturen weisen alle auf denselben strukturellen Übergang hin:

Die Zukunft der KI-Skalierung hängt zunehmend von energieeffizienter Bereitstellung von Intelligenz ab und nicht allein von brutaler Expansion reiner Rechenleistung.

Unter KI-Energie-Bedingungen wird Effizienz selbst zu strategischer Macht.

6. IoT und industrielle KI offenbaren die Grenzen cloud-zentrierter Architektur

Das europäische Cloud-Edge-Kontinuum erkennt zutreffend an, dass Intelligenzsysteme nicht vollständig zentralisiert bleiben können.

Die strategische Bedeutung dieses Übergangs wird jedoch häufig unterschätzt, weil IoT-Systeme oftmals lediglich als sekundäre Anwendungsfälle behandelt werden und nicht als grundlegende Treiber verteilter Intelligenz.

Industrielle Systeme erzeugen zunehmend kontinuierliche operative Echtzeitdaten über:

Stromnetze,

Häfen,

Logistik,

Fertigung,

Landwirtschaft,

Transport,

Gesundheitssysteme,

Verteidigungssysteme,

und urbane Infrastruktur.

Diese Systeme operieren unter strikten Anforderungen hinsichtlich:

Latenz,

Zuverlässigkeit,

Kontinuität,

Cybersicherheit,

und Energieeffizienz.

Unter solchen Bedingungen werden cloud-abhängige Intelligenzarchitekturen zunehmend fragil.

Eine Fabrik kann nicht dauerhaft von entfernter Ausführung abhängig sein, um operative Kontinuität aufrechtzuerhalten.

Ein Netzstabilisierungssystem kann sich während Instabilitätsphasen nicht vollständig auf entfernte Cloud-Koordination verlassen.

Ein Logistiknetzwerk kann lokale Entscheidungsfindung nicht aussetzen, weil Konnektivität beeinträchtigt wird.

Ein industrielles KI-System kann operative Intelligenz nicht vollständig an externe Kontrollschichten auslagern, ohne systemische Verwundbarkeit zu erzeugen.

Deshalb treibt industrielle KI zunehmend verteilte Rechenarchitekturen voran.

Die strategische Frage ist nicht Dezentralisierung um ihrer selbst willen.

Die strategische Frage lautet vielmehr, ob Intelligenz unter realen physischen Bedingungen operativ funktionsfähig bleibt.

7. Hybride KI-Architektur und die Zukunft der Rechenleistung

Das zukünftige KI-System wird wahrscheinlich hybrid sein und nicht vollständig zentralisiert oder vollständig verteilt.

Das Training von Frontier-Modellen wird konzentriert bleiben, weil fortgeschrittene Trainingssysteme benötigen:

massive Energieversorgung,

dichte Infrastruktur,

fortgeschrittene Beschleuniger,

Hyperscale-Kapitalpools,

und spezialisierte Ökosystemkonzentration.

Die Inferenz verteilt sich jedoch zunehmend in operative Systeme hinein.

Während KI sich von der Modellentwicklung zur gesellschaftlichen Implementierung bewegt, wird Intelligenz zunehmend ausgeführt über:

Geräte,

industrielle Systeme,

Robotik,

Fahrzeuge,

Stromnetze,

Logistiksysteme,

Edge-Infrastruktur,

und lokale Rechenumgebungen.

Dies erzeugt einen strukturellen Übergang von konzentriertem Training hin zu verteilter operativer Intelligenz.

Der strategische Konflikt verschiebt sich daher.

Die zentrale Frage lautet nicht länger lediglich, wer die größten Modelle besitzt.

Die tiefere Frage lautet zunehmend, wer die umfassendere Architektur kontrolliert, über die Intelligenz innerhalb der Gesellschaft bereitgestellt wird.

Unter hybriden KI-Architekturen hängt Macht zunehmend ab von der Integration von:

Halbleitern,

Energiesystemen,

Edge-Infrastruktur,

Cloud-Koordination,

industriellen Ökosystemen,

Konnektivität,

und Rechenleistungsplatzierung.

Dieser Übergang begünstigt stark souveränitätsbasierte Ökosystemmodelle gegenüber isolierten technologischen Fähigkeiten.

8. Konnektivität wird Teil der Rechenarchitektur

Sobald Intelligenz echtzeitfähig und verteilt wird, wird Konnektivität selbst Teil des rechnerischen Systems.

5G, Glasfasersysteme, Edge-Orchestrierung, private industrielle Netzwerke, Satellitensysteme und Unterseekabel fungieren zunehmend als Komponenten der umfassenderen Intelligenzarchitektur.

Dies verändert die strategische Bedeutung von Telekommunikationsinfrastruktur.

Die Frage betrifft nicht länger lediglich Kommunikationsgeschwindigkeit.

Die Frage betrifft zunehmend operative Kontrolle über:

Aktualisierungssysteme,

Orchestrierungsschichten,

Software-Governance,

Wartungszyklen,

Infrastruktur-Interoperabilität,

und Echtzeit-Systemkoordination.

Dies erklärt, weshalb Telekommunikationsinfrastruktur geopolitisch geworden ist.

Die tiefere strategische Frage war niemals lediglich Spionage.

Es ging um Kontrolle über das operative Gewebe, durch das Intelligenzsysteme funktionieren.

In KI-Energie-Systemen wird Konnektivität zunehmend untrennbar von Rechenleistung selbst.

9. Strategische Mineralien verbinden KI erneut mit industrieller Souveränität

Künstliche Intelligenz verbindet Halbleitersysteme zunehmend erneut mit den zugrunde liegenden mineralischen Architekturen, von denen fortgeschrittene Rechenleistung abhängt.

Halbleiterfertigung, elektrische Systeme, Batterien, Robotik, Übertragungsinfrastruktur, erneuerbare Energiesysteme, Verteidigungselektronik, Kühlsysteme und Hyperscale-Recheninfrastrukturen hängen alle von zunehmend konzentrierten Ökosystemen strategischer Mineralien und Seltene-Erden-Verarbeitung ab.

Unter KI-Energie-Bedingungen fungieren diese Materialien nicht länger lediglich als Rohstoffe innerhalb industrieller Lieferketten.

Sie fungieren zunehmend als grundlegende Inputs der rechnerischen Zivilisation selbst.

Dieser Übergang verwandelt strategische Mineralien in Souveränitätsinfrastruktur, eingebettet innerhalb der umfassenderen Architektur von:

Energiesystemen,

industriellen Ökosystemen,

Rechenleistungsskalierung,

Halbleiterproduktion,

und geopolitischer Macht.

Die strategische Frage reicht daher weit über reine Rohstoffförderung hinaus.

Die kritische Frage betrifft zunehmend:

Verarbeitung,

Raffinierung,

Fertigungsintegration,

industrielle Ökosysteme,

logistische Koordination,

und energieintensive nachgelagerte Produktion.

Das zukünftige KI-System ist daher untrennbar mit industrieller Souveränität verbunden.

10. Europas fehlende Konversionsschicht

Europa besitzt wichtige strategische Vermögenswerte innerhalb des umfassenderen KI-Energie-Systems.

Es verfügt über:

industrielle Kapazitäten,

ingenieurtechnische Expertise,

Infrastrukturdichte,

fortgeschrittene Forschungssysteme,

strategische Engpässe bei Halbleitern,

Ausbaukapazitäten für erneuerbare Energien,

und hochentwickelte industrielle Ökosysteme.

Europa hat jedoch häufig Schwierigkeiten, diese Fähigkeiten in kohärente Systeme souveräner Macht zu integrieren.

Dies ist das umfassendere Konversionsproblem.

KI-Politik, Halbleiterpolitik, Telekommunikationspolitik, Energiepolitik, Industriepolitik, Infrastrukturpolitik und strategische Autonomie bleiben häufig institutionell fragmentiert.

Infolgedessen riskiert Europa, partielle Fähigkeiten ohne integrierte Souveränität hervorzubringen.

Eine Halbleiterstrategie ohne Rechenleistungsplatzierung bleibt unvollständig.

Eine Cloud-Strategie ohne verteilte Intelligenz reproduziert Abhängigkeit.

Eine Energiewende ohne Rechenleistungs-Konversion schwächt industrielle Wettbewerbsfähigkeit.

Eine Digitalstrategie ohne Infrastruktur-Souveränität lässt operative Kontrolle externalisiert.

Die europäische Herausforderung ist daher architektonischer und nicht rein technologischer Natur.

Europa fehlt es nicht an Vermögenswerten.

Es fehlt an einer ausreichend integrierten Konversionsarchitektur über den gesamten KI-Energie-Stack hinweg.

11. Das Mittelmeer als Rechenleistungs-Energie-Schnittstelle

Das Mittelmeer nimmt zunehmend eine wichtige Position innerhalb Europas zukünftiger Rechenleistungs- und Energiegeografie ein.

Die Region liegt entlang von:

Energiekorridoren,

Stromverbundsystemen,

maritimen Logistikrouten,

Unterseekabelsystemen,

LNG-Infrastruktur,

Zonen erneuerbarer Energien,

industriellen Knotenpunkten,

und strategischen Infrastrukturschnittstellen zwischen Europa, Afrika und dem Nahen Osten.

Unter traditionellen Wirtschaftsmodellen durchliefen diese Ströme das Mittelmeer häufig, ohne vollständig in regionale Systemmacht umgewandelt zu werden.

Unter KI-Energie-Bedingungen erhält diese Geografie neue Bedeutung.

Verteilte Intelligenzarchitekturen profitieren zunehmend von:

regionaler Infrastrukturdichte,

Energieverfügbarkeit,

Integration von Verbundsystemen,

resilienter territorialer Verteilung,

und Rechenleistungs-Lokalität.

Dadurch entsteht die Möglichkeit, dass Teile des Mittelmeerraums sich zu verteilten Infrastrukturnoten innerhalb Europas umfassender KI-Energie-Architektur entwickeln.

Die Chance betrifft daher nicht lediglich Energieproduktion.

Sie betrifft zunehmend die Umwandlung von Energie in Rechenleistung.

12. Das strategische Risiko, wenn Europa Rechenleistungs-Lokalität ignoriert

Wenn Europa künstliche Intelligenz primär verfolgt durch:

Hyperscale-Expansion,

importierte Beschleuniger,

zentralisierte Cloud-Abhängigkeit,

und Konzentration energieintensiver Rechenzentren,

riskiert es, strukturelle Abhängigkeit genau in dem Moment zu vertiefen, in dem es Souveränität erreichen möchte.

Unter einer solchen Entwicklung:

steigt der Druck auf Stromsysteme,

intensiviert sich Infrastrukturkonzentration,

erweitert sich Abhängigkeit von externen Plattformen,

bleibt operative Kontrolle fragmentiert,

und schwächt sich Ökosystem-Souveränität ab.

Europa würde damit Abhängigkeit innerhalb einer neuen technologischen Architektur reproduzieren und diesen Prozess zugleich als digitale Modernisierung beschreiben.

Dies würde ein systemisches strategisches Versagen darstellen.

Schlussfolgerung: Souveränität beginnt unterhalb der Cloud

KI-Souveränität beginnt nicht primär auf der Anwendungsebene.

Sie beginnt unterhalb der Cloud.

Sie beginnt dort, wo:

Mikroprozessoren,

Stromsysteme,

Rechenleistungsplatzierung,

Kühlsysteme,

industrielle Infrastruktur,

Konnektivitätsarchitekturen,

und operative Kontrollsysteme

miteinander interagieren, um zu bestimmen, ob Intelligenz unter Bedingungen physischer Begrenzung autonom funktionieren kann.

Das zukünftige KI-System wird nicht ausschließlich dadurch definiert werden, wer die größten Modelle oder die größten Mengen an Rechenleistung besitzt.

Es wird zunehmend dadurch definiert werden, wer integrieren kann:

Energiesysteme → Recheninfrastruktur → Halbleiter-Ökosysteme → industrielle Implementierung → verteilte Intelligenz → souveräne operative Kontrolle

zu kohärenten Systemen dauerhafter Macht.

Das Halbleiterzeitalter schuf die materielle Grundlage des digitalen Zeitalters.

Das KI-Energie-Zeitalter wird bestimmen, welche Gesellschaften Rechenleistung in resiliente zivilisatorische Infrastruktur umwandeln können.